سایبرنما-۶۱

مجله هفتگی سایبرنما با معرفی آخرین و مهم ترین رخدادهای تکنولوژیک دنیا و تبیین اهمیتِ آنها در آیندهی بشریت، شما را با مسیر انقلاب تمدنی سایبری آشنا می کند.

💠 خبرهای این هفتهی سایبرنما با پژوهشی در مورد کاربردِ دوگانهی هوشهای مصنوعی در تولید دارو و تسلیحات شیمیایی آغاز میشود.

💠 سپس مبتنی بر یک پیمایش در دانشگاه برکلی از پیشرفتهای خیرهکنندهی هوشهای مصنوعی در تولید تصویر از چهرههای انسان و جلبِ اعتمادِ انسانها خواهیم گفتیم.

💠 سومین خبر این هفتهی سایبرنما به روباتهای ژاپنیای اختصاص دارد که توسطِ تکنولوژی VR و اپراتور کنترل میشوند.

💠 در ادامه از دستآوردِ محققان و ابرکامپیوترهای چینی در حل یک مسئلهی قدیمی کوانتوم خواهیم گفت.

💠 و در آخرین خبر این هفته به جدیدترین مقرراتگذاری و تنظیمگری اتحادیهی اروپا در قبال خدمات و پلتفرمهای بزرگ سایبری خواهیم پرداخت.

نسل جدیدِ تسلیحاتِ شیمیایی با استفاده از هوش مصنوعی

تا کنون در سایبرنما از تکنولوژیهای سایبریای سخن گفته بودیم که در راستای سمزدایی یا تولید دارو به کار میرفتند اما چه میشود اگر هدفِ کسی «تولیدِ داروهای سمی» (یا همان سلاح شیمیایی) باشد؟ آیا تکنولوژیهای سایبری میتوانند در راستای چنین نیتِ شومی به کار گرفته شوند؟ پاسخ به چنین سوالی مثبت است. هوشهای مصنوعی به جهتِ توانایی بالای خود در تشخیصِ ترکیباتِ شیمیایی همواره به عنوان یکی از تاثیرگذارترین عوامل در پزشکی سایبری شناخته میشوند. با این حال در مقالهای که هفتهی گذشته در نشریهی معتبرِ Nature چاپ شد، محققان در مورد کاربرد دوگانهی هوش مصنوعی در جهت تولید سلاحهای شیمیایی هشدار دادند و آن را «نسلِ جدیدِ سلاحهای شیمیایی» خواندند. این هشدار در حالی مطرح شده است که به نظر میآید دولتها (به خصوص ایالات متحده) با دعوتِ شرکتهای هوش مصنوعیِ دارویی به پایگاههای نظامی و استفاده از این شرکتها برای تولیدِ موادِ شیماییِ سمیِ جدید، به خوبی از این کاربردِ دوگانه آگاه هستند. هوشهای مصنوعی هم جنگافزار هستند و هم میتوانند سلاحهای جدید تولید کنند. استنکاف ایالات متحده از پیوستن به پیمانهای منعِ توسعهی سلاحهای هوشمند به خوبی نشانگرِ این مسئله است که جهانِ آینده، جهانِ جنگهایی است که در آن سلاحهای مبتنی بر هوشِ مصنوعی حکمفرما خواهند بود.

پیشرفتهای خیرهکنندهی هوشهای مصنوعی در تولید تصویر از چهرهی انسانها

در شمارهی گذشتهی سایبرنما از دستآوردهای شگفتانگیزِ سیستمهای GAN صحبت کردیم: این که چگونه هوشهای مصنوعی میتوانند تصاویری اعجابانگیز (و حتی هنری) را تولید (خلق؟) کنند. این هفته از پژوهشی خواهیم گفت که تاثیر تولیداتِ هوش مصنوعی بر انسانها را میسنجد. پژوهشگران دانشگاه برکلی ۲ مسئلهی اصلی را کاوش کردهاند: ۱) آیا مردم میتوانند چهرههای انسانیای که توسطِ هوش مصنوعی ساخته شده است را تشخیص دهند؟ و ۲) مردم به کدام چهرهها اعتمادِ بیشتری دارند؟ نتایج این پژوهش شگفتآور بود: مردم دیگر نمیتوانند چهرهی تولیدشده توسطِ هوش مصنوعی را از چهرههای واقعی تشخیص دهند. آیا آزمایش تورینگ به چالش کشیده شده است؟ در مرحلهی دومِ این آزمایش، ۸۰۰ تصویر از چهرهی انسانها به مردم نشان داده شد. از میانِ این ۸۰۰ تصویر ۱۲۳ تصویر چهرههای تولیدشده توسط هوش مصنوعی بود. در پایانِ آزمایش بالاترین میزانِ «اعتمادپذیری» به ۳ تصویری اختصاص یافت که توسط هوش مصنوعی تولید شده بودند. به نظر میرسد این روزها هوشهای مصنوعی بهتر از خودمان از احوالاتِ ما آگاه هستند و دقیقاً میدانند که چه تصویری تولید کنند تا ما انسانها بیشترین حسِ اعتمادِ خودتان را معطوف بدان بداریم. مسائل اخلاقی هوش مصنوعی دیگر چیزی دور از ما و در فیلمهای علمی-تخیلی نیست. آنها همین امروز تبدیل به «معضل» شدهاند.

کنترل روباتهای کارگر با استفاده از تکنولوژی VR

مسئلهی روباتیک در ژاپن صرفاً یک مسئلهی تکنولوژیک نیست بلکه یک مسئلهی فرهنگی هم محسوب میشود. این کشور سومین کشور در زمینهی چگالی روباتیک است و پیشتازِ صنعتِ روباتیکِ پرستاری است. ژاپنیها حتی به حشرات هم رحم نکردهاند و آنها را تبدیل به سایبورگ کردهاند. بنابراین عجیب نیست که تکنولوژیهای روباتیکِ جدید و جالبِ توجهی را از این سرزمین انتظار داشته باشیم. در این شماره به روباتهای غولپیکری خواهیم پرداخته که توسطِ تکنولوژی VR کنترل میشوند. یک شرکتِ راهسازی در ژاپن اعلام کرده است که از این روباتها برای ساخت و سازهای عظیم و انبوه بهره خواهد برد. این روباتها شمایلی انساننما دارند و انسانها به جای آن که میخهای عظیمِ آهنی را با دستهای خودشان بکوبند، از این روباتها استفاده میکنند. همچنین این تکنولوژی نه تنها تصویر و صدا که وزن و جاذبه را نیز به اپراتور منتقل میکند. در واقع، کارگرانِ ژاپنی، اکنون بدل به «کنترلکنندگانِ روبات» شدهاند. اگر در آینده مشاغل از دست نروند، قاعدتاً «مهارتِ دیجیتالی کارگران و کارکنان» اصلیترین مهارتِ آنها خواهد بود. البته شرکتِ راهسازیِ مذکور استفاده از این روباتها را تا سالِ ۲۰۲۴ (و اخذِ مجوزهای لازم) به تعویق انداخته است اما نسخههای اولیه نشان میدهند که میتوان به کاربردی بودنِ چنین روباتهایی امیدِ فراوانی داشت.

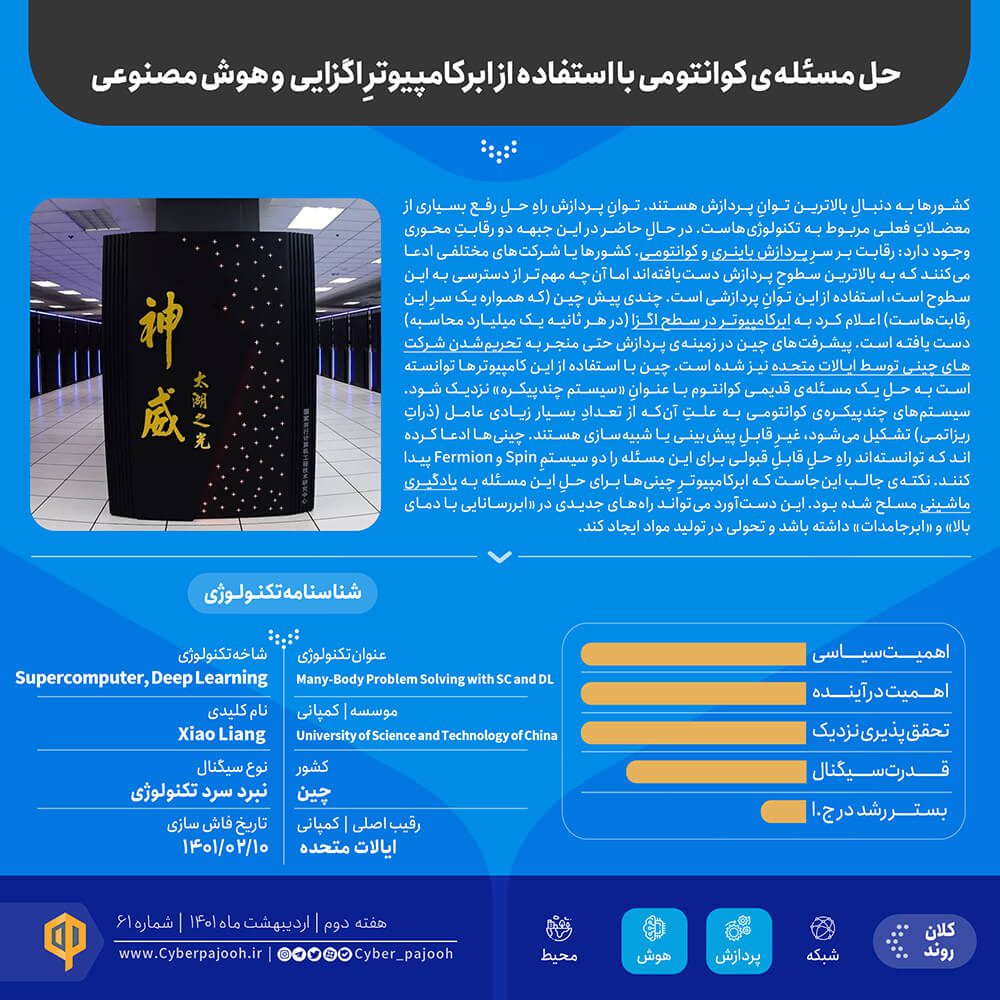

حل مسئلهی کوانتومی با استفاده از ابرکامپیوترِ اگزایی و هوش مصنوعی

کشورها به دنبالِ بالاترین توانِ پردازش هستند. توانِ پردازش راهِ حلِ رفع بسیاری از معضلاتِ فعلی مربوط به تکنولوژیهاست. در حالِ حاضر در این جبهه دو رقابتِ محوری وجود دارد: رقابت بر سرِ پردازش باینری و کوانتومی. کشورها یا شرکتهای مختلفی ادعا میکنند که به بالاترین سطوحِ پردازش دستیافتهاند اما آنچه مهمتر از دسترسی به این سطوح است، استفاده از این توانِ پردازشی است. چندی پیش چین (که همواره یک سرِ این رقابتهاست) اعلام کرد به ابرکامپیوتر در سطح اگزا (در هر ثانیه یک میلیارد محاسبه) دست یافته است. پیشرفتهای چین در زمینهی پردازش حتی منجر به تحریمشدن شرکتهای چینی توسط ایالات متحده نیز شده است. چین با استفاده از این کامپیوترها توانسته است به حلِ یک مسئلهی قدیمی کوانتوم با عنوانِ «سیستم چندپیکره» نزدیک شود. سیستمهای چندپیکرهی کوانتومی به علتِ آنکه از تعدادِ بسیار زیادی عامل (ذراتِ ریزاتمی) تشکیل میشود، غیرِ قابلِ پیشبینی یا شبیهسازی هستند. چینیها ادعا کردهاند که توانستهاند راهِ حلِ قابلِ قبولی برای این مسئله را دو سیستمِ Spin و Fermion پیدا کنند. نکتهی جالب اینجاست که ابرکامپیوترِ چینیها برای حلِ این مسئله به یادگیری ماشینی مسلح شده بود. این دستآورد میتواند راههای جدیدی در «ابررسانایی با دمای بالا» و «ابرجامدات» داشته باشد و تحولی در تولید مواد ایجاد کند.

دستورالعمل خدماتِ دیجیتال اتحادیهی اروپا: جدیدترین تنظیمگری سختگیرانهی اروپا

یکی از اصلیترین سیاستهای کلانِ اتحادیهی اروپا در میانهی نبردهای مختلفِ تکنولوژیک میانِ چین و آمریکا، جلوگیری از «تسلط سایبری» این دو کشور بر کشورهای اتحادیه به واسطهی مقرراتگذاریهای سختگیرانه است. هر چند این مقررات در ظاهر به عنوانِ «حمایت از کاربران» منتشر میشود، اما بیش از هر چیز منجر به استقلال این اتحادیه نسبت به «حکمرانی سایبری شرکتهای شرقی و غربی» میشود. مقرراتی مانندِ هوش مصنوعی یا خودروهای خودران یا مقررات مشهور GDPR از این دست هستند. آخرین محصولِ رویکردِ سختگیرانهی این اتحادیه طرحی موسوم به DSA (دستورالعمل خدمات دیجیتال) است که در آن شرکتهای مختلف باید منطقِ عملکردِ الگوریتمهای مختلف خود را به کاربران و پژوهشگران توضیح دهند. الگوریتمها اساسیترین داراییهای شرکتهای مختلف هستند و حفاظت از این الگوریتمها برای آنها بسیار مهم است. بنابراین آنها در مقابلِ افشای این الگوریتمها مقاومت خواهند کرد. همچنین الگوریتمها نشان خواهند داد که شرکتها چگونه از دادههای کاربران استفاده میکنند و امکان دارد که شرکتها دچار تبعاتِ قانونی شوند. به نظر میآید شرکتهایی مانند فیسبوک، گوگل و توییتر دچار چالشی بزرگتر از قانونِ GDPR شده باشند. همچنین در این دستورالعمل وظایفی به پلتفرمهای بزرگ در قبال بحرانها (متاثر از جنگ اوکراین) نیز محول شده است. آنها میباید استراتژیهای مقابله با توزیعِ اطلاعات غلط در بحرانها را به اتحادیه ارائه دهند.